En una era en la que la tecnología de IA avanza rápidamente. Los Grandes Modelos de Lenguaje (LLM) se han convertido en una herramienta importante para el procesamiento y la construcción del lenguaje humano. Sin embargo, los LLM sufren el problema de no poder aprender nuevos datos que se producen después de la fecha de corte del modelo.

have Uno de los estudios La solución es "Supervised Fine-Tuning" (SFT) para permitir que los LLM aprendan y comprendan nueva información de manera efectiva.

Métodos de estudio

Los investigadores experimentan con datos de eventos deportivos que tendrán lugar en 2023, como la Copa Mundial Femenina y la Super Bowl, para crear conjuntos de datos para entrenar a los LLM. Hay dos formas de crear un conjunto de datos:

- Basado en tokens: cree un par de preguntas y respuestas en función del número de palabras de un documento.

- Basado en hechos (Basado en hechos): Concéntrese en crear un par de preguntas y respuestas que cubra todos los hechos del documento. Ideal para datos que requieren exactitud y exactitud.

Los investigadores utilizaron el modelo GPT-4, cuyo conocimiento es limitado hasta septiembre de 2021, para entrenar con los conjuntos de datos generados, utilizando técnicas LoRA (Low-Rank Adaptation) para acelerar el proceso de entrenamiento y hacerlo menos requisitivo.

```

W = W0 + BA

```

Donde 'W0' es la matriz de peso original, 'B' y 'A' son matrices de rango bajo, y 'W' es la matriz de peso mejorada.

Resultados

- La SFT realmente mejora los LLM: Los experimentos han demostrado que la SFT puede aumentar significativamente la capacidad de los LLM para responder preguntas sobre nuevos datos.

- Cómo crear un conjunto de datos eficaz: Los conjuntos de datos basados en hechos proporcionan mejores resultados que los conjuntos de datos tokenizados porque cubren los datos a fondo y reducen el riesgo de que el modelo se pierda en datos irrelevantes.

- Comparación con RAG: Mientras que SFT no puede superar la recuperación de datos de bases de datos externas (Retrieval-Augmented Generation o RAG), SFT tiene la capacidad de recordar datos sin depender de la búsqueda. Esto hace que sea más rápido responder a las preguntas y utiliza menos recursos.

- Personalización de parámetros: la personalización de parámetros, como la tasa de aprendizaje y el número de ciclos de entrenamiento (épocas), puede afectar significativamente al rendimiento del modelo.

Limitaciones del estudio

Este estudio tiene limitaciones que deben ser consideradas:

- Tamaño y tipo de conjunto de datos: Es posible que el conjunto de datos utilizado para el entrenamiento no esté completo. El uso de un conjunto de datos más grande y diverso puede producir resultados diferentes.

- Selección de modelos: El uso de GPT-4 como modelo base puede afectar a los resultados. La experimentación con otros modelos, como Llama 2 o Bard, puede arrojar diferentes perspectivas.

- Capacidad de generalización: Los modelos entrenados con SFT pueden tener capacidades de generalización limitadas, lo que los hace inadecuados para otros tipos de datos.

- Predisposición: El conjunto de datos utilizado en el entrenamiento puede estar sesgado, lo que hace que el modelo genere resultados no sesgados.

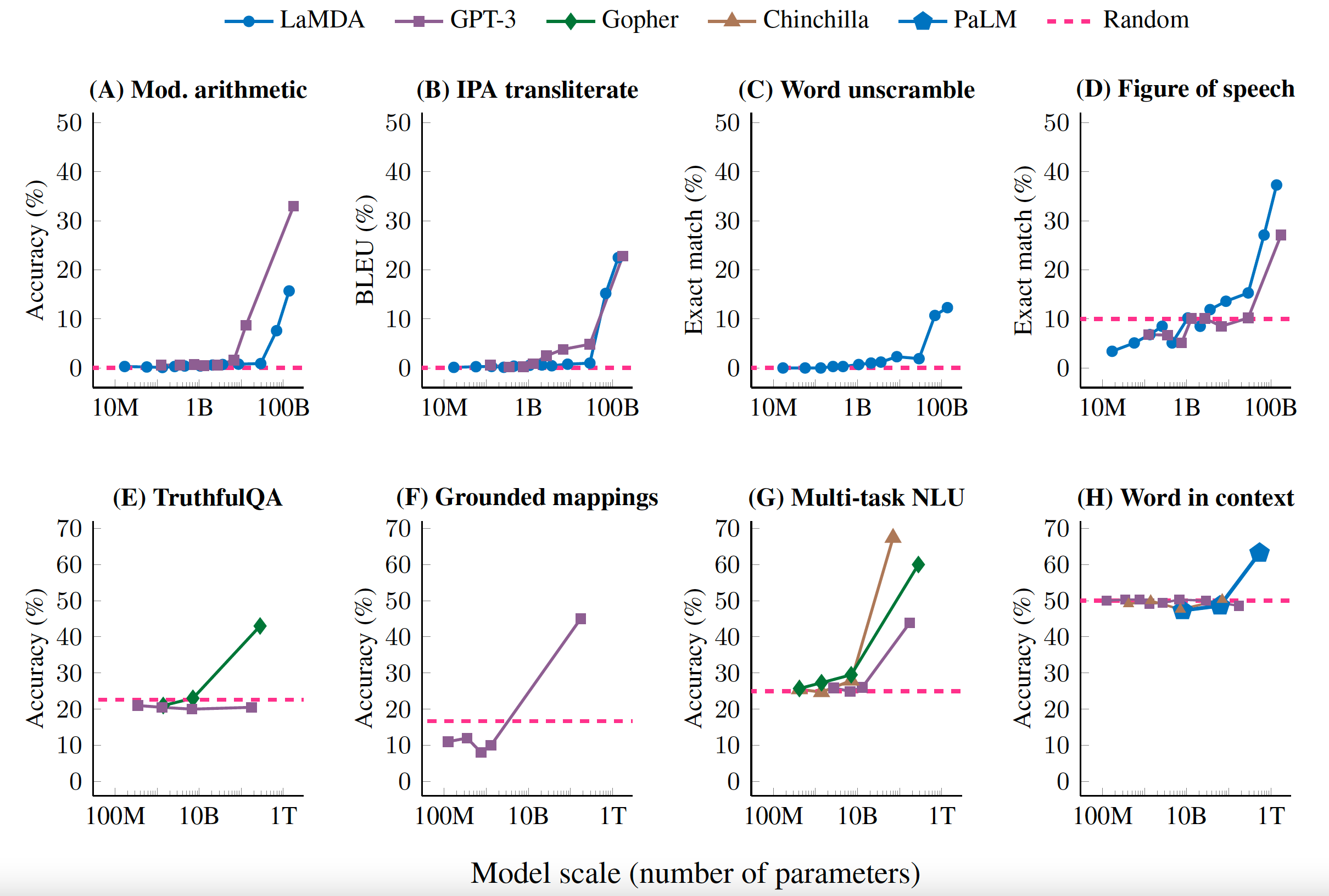

Un ejemplo del rendimiento de los LLM frente al tamaño del modelo. Demuestra la importancia del escalado del modelo para mejorar el rendimiento.

Importancia y aplicación

Esta investigación es importante para el desarrollo de la IA y los LLM en el mundo real, especialmente en áreas que requieren información actualizada, como:

- Noticias y eventos actuales: Los LLM mejorados con SFT pueden proporcionar una mejor información actualizada sobre eventos recientes, como resúmenes de noticias, análisis de eventos y más.

- Análisis de mercado y tendencias comerciales: Los modelos pueden aprender y analizar rápidamente nuevos datos en el mercado, como predicciones de tendencias de precios. Análisis del sentimiento del cliente

- Investigación Científica: LLMs Pueden actualizar continuamente sus conocimientos sobre nuevos descubrimientos científicos, como resumir investigaciones y encontrar relaciones entre datos.

- Educación y aprendizaje: los sistemas de IA utilizados en la educación pueden mantener contenidos actualizados, como la creación de ejercicios, la impartición de instrucciones, etc.

Los LLM mejorados con SFT se pueden aplicar en productos como ChatGPT, Bard o Llama 2 para proporcionar capacidades de respuesta a preguntas más actualizadas y precisas.

Cuestiones éticas

El desarrollo y la implementación de LLM en mejora continua deben tener en cuenta cuestiones éticas importantes, entre ellas:

- Gestión de datos que pueden no ser precisos o verdaderos

- el riesgo de utilizarlo para crear contenidos deepfake o piratería;

- Comprobación de posibles sesgos en los resultados

resumir

Este desarrollo es un paso importante para hacer que la IA sea más resistente y adaptable.

Hacer frente mejor a un mundo que cambia rápidamente.

Sin embargo, todavía existen desafíos para desarrollar métodos de capacitación más efectivos y encontrar un equilibrio entre el aprendizaje de nueva información y la retención de conocimientos antiguos.

En el futuro, es posible que veamos el desarrollo de LLM que puedan seguir aprendiendo y adaptándose, lo que será beneficioso para construir sistemas de IA inteligentes y actualizados.

Chatea con los trabajos de investigación aquí